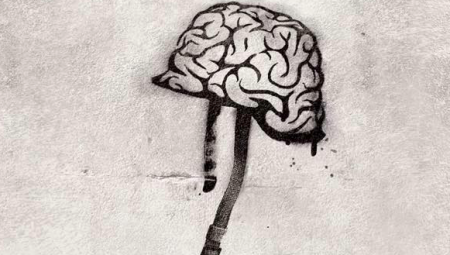

Cum antrenăm sistemele A.I. (Inteligență Artificială)? Sunt ele capabile să recunoască tipare umane precum ura, violența (fizică sau verbală) sau comportamentul rasial? Răspunsul nu e atât de ușor sau simplu precum ați crede.

Felul nostru de a fi nu este unul care să inspire încredere, iar tiparele comportamentale se aplică în atât de multe condiții, încât e greu de determinat (în termeni de 1 și 0) când un om moare sau…doar mimează moartea. Scriu toate astea în condițiile în care mulți se întreabă de ce sistemele Facebook (de recunoaștere a comportamentelor nedorite) nu au acționat în cazul masacrului din Christchurch? Pentru că tiparul violent și tiparul comportamentul rasial sunt cel mai greu de analizat!

Este mult mai ușor să propui unui sistem să detecteze armele, spre exemplu. Insă, tocmai de aici se pune problema de context – și totodată întrebarea: poate un sistem A.I. să ÎNȚELEAGĂ contextul? Adică poate determina cu ACURATEȚE, dacă sunt imagini care arată un act violent aflat în desfășurare sau e vorba doar de o știre, o piesă de teatru, o partida de tir, un biatlon, un joc de paintball, airsoft sau o partida de vânătoare?

Am zis să îi întreb și pe “băieții cu tehnologia” pe care i-am avut alături, în Guerrilla CAMP. Primul a fost Bogdan Bocșe, de la EnVisage. Și el vede problema că fiind una dificilă și ne întreabă dacă VREM cu adevărat să lăsăm această detecție pe mâinile unei inteligente artificiale:

“Sunt mai multe răspunsuri:

1. Adâncimea informației – un nud are aceeași discriminatori similari în toate culturile, rasele, țările, etniile; pe de alte parte, comportamentul “rasial” sau “violent” are o paleta mult mai amplă de variație, în funcție de obiceiuri, de țară, ceea ce face din distingerea (decelarea) acelor comportamente o problema de căutare a mai multor ace, eventual mai mici, în multe mai multe caruri cu fan.

2. Non-stationareitatea modelelor pe baza cărora se clasifică modele sau persoane (heteroscedasticitate s-ar numi, hetero – diferit; skedasis – împrăștiere. Semnificația lucrurilor se schimbă în funcție de istorie, în funcție de cum interesele maselor de oameni au avut diferite conotații, implicații și semnificații în diferite momente, după cum acele momente au fost înainte sau după unei schimbări majore în mentalul colectiv (blockchain-ul uman, cum s-ar zice). Gândește-te așa: același steag poate fi un simbol interzis sau poate fi un atârnat în față instituțiilor publice – în funcție de cum privești problema înainte de 1932 sau după 1945.

3. Accesul la informație. Am fi de acord că rețelele sociale și alți operatori de date (Twitch, Twitter, Google, Apple, Amazon etc) să le poată fi cerut de către stat (poliție, armata, anti-tero, trupe speciale etc) ajutorul în situații de urgență, cu acordul unui judecător, să rechizitioneze device-urile mobile ale ostatecilor, ale agresorilor sau teroriștilor, în scopul reducerii pierderii de vieți omenești? Merită oare să compromitem principiul neimixtiunii statului în afacerile personale ale cetățeanului pentru a evita o pierdere de vieți omenești comparabilă cu pierdere de vieți omenești pe care am putea-o cruța dacă am mânca doar mai puțini cheeseburgeri?”

Un alt cunoscut, Ovidiu Diaconescu ( jumătatea AlterEgoTechnology) crede la fel, că tiparele comportamentale sunt greu de definit, pe când un nud este ușor de analizat la nivel de imagine:

“Faza cu cel din Nouă Zeelandă, care s-a filmat FPS în timp ce trăgea, arată fix că un joc sau un airsoft/paintball. Noi că oameni știm diferența contextual și aici cred eu că trebuie explorată ideea. E greu fără context. Poate că Youtube și Facebook ar trebui să bage și analiză pe comentarii sau “viewing pattern”, că să înțeleagă dacă e ceva ilegal sau doar o formă de artă.”

Eu cred că discuția rămâne deschisă și sunt multe aspecte ce trebuie analizate. Însă un lucru e cert: ne îndreptăm către punctul inm care va trebui să alegem ce VREM cu adevărat.

Sursă foto cover aici.